九游会J9端侧模子期间的大幕就被缓缓拉起-九游娱乐(China)官方网站

行至2024九游会J9,云霄大模子还未分出输赢,端侧模子早已硝烟四起。

旧年上半年,谷歌以可在出动斥地上离线运行的PaLM2轻量级选手“壁虎”打响了端侧模子第一枪,到了年底,端侧模子期间的大幕就被缓缓拉起。

法国创企Mistral AI起初发布Mixtral 8x7B模子,微软更是半年时期加快跑,从27亿参数的Phi-2到SLM(小话语模子)Phi-3系列,以“低廉得多,但反映才能接近比它大10倍的模子”强调高性价比。

Google佩戴Gemma模子向Meta的Llama-2大模子发起挑战,苹果也以“小模子”眷属宣告离“让东谈主工智能在苹果斥地上腹地运行”想法更近一步。

而大洋此岸的另一侧,在中国上海张江,也有这样一家通用大模子厂商,驶上了端侧模子的快车谈,以类脑分区激活的责任机制、矫正反向传播算法迟缓竣事“同步学习”,并在走通多模态上起初“卷”入。

这,等于岩芯数智CEO刘凡平带队的RockAI。

Yan 1.2跑通树莓派,“为斥地而生”水到渠成

事实上,本年1月,RockAI发布的国内首个非Attention机制的通用当然话语大模子——Yan1.0模子,就标记走向斥地端的第一步。

其时这一模子100%相沿私有化部署期骗,不经编著和压缩即可在主流消费级CPU等端侧斥地上无损运行,在研究东谈主员现场对Yan 1.0模子在Mac条记本上的运行推理展示中,刘凡平也画出了接下来将在愈加便携的斥地或终局中进行无损部署的蓝图。

而咫尺,随着Yan 1.0迈入1.2阶段,“在树莓派上起初跑通”把其在更低端斥地的无损适配从预期变为了现实。

图为Yan架构模子在树莓派上运行

树莓派别列行为巨匠最为闻明的袖珍型工整却又性能高大的袖珍电脑,可平日期骗于物联网、工业自动化、机灵农业、新动力、智能家居等场景及斥地,比方门禁、机器东谈主等终局,但它虽具备扫数PC的基本功能,却是算力最低的斥地代表。

同期,树莓派大部分情况莫得联网,这就意味着,跑通树莓派,等同于开放了低算力斥地端的大门以及不联网的多场景期骗。

不外,机遇之大,挑战亦不小,不少大模子玩家都憋屈于“有损压缩”。

就连4月网友发现能在树莓派5以每秒1.89个token的速率运行,相沿8K高下文窗口的Llama3 8B ,亦然弃取把模子量化编著后压到极致的姿首。

而这就如同把平铺的纸揉小后放入,会导致纸张有褶皱般,让多模态下的性能耗损无法收复到原有情状去进行模子考试,同期也陪同着卡住不动、死机等不坚信情况发生。

此时,原生无损放入的迫切性就突显,而这恰是RockAI基于底层本领作念“阻难式”调动的上风所在。

不同于传统Transformer模子自带算力滥用和幻觉等问题,Yan架构为低算力斥地运行而生,1.0版就以百亿级参数比好意思千亿参数大模子的性能成果,以挂牵才能援助3倍、考试遵守援助7倍的同期,竣事推理隐约量的5倍援助,竣事云霄运行的高性价比。

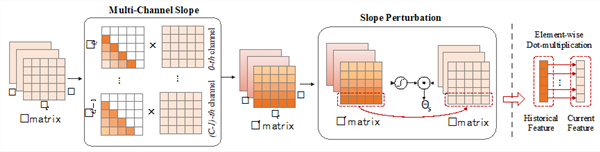

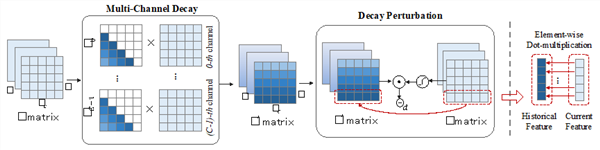

图为Yan架构模子的关键模块MCSD Block,引自Yan架构论文: 《MCSD: An Efficient Language Model with Diverse Fusion》

对比数据标明,在单张4090 24G显卡上,当模子输出token的长度超出2600时,Transformer的模子会出现显存不及,而Yan模子的显存使用历久踏确凿14G傍边,表面上能够竣事无穷长度的推理。

再到让通用大模子去兼容更多的斥地,竣事更多个性化的斥地端期骗,则让RockAI在同模子架构下,可水到渠成地“为斥地而生”。

那么,关于树莓派这一门槛,RockAI是何如破局的呢?谜底就在本领调动上。

自创业之初,刘凡平就一直在想考“大模子动辄上万亿的token考试是否确凿必要”,以东谈主类大脑几十亿的考试量来看,他判断,数据、算力并不是最终的瓶颈,架构、算法才是迫切的影响身分。

故而在跑通树莓派的路上,基于全新自研的Yan架构,RockAI在实验室对东谈主工神经集会最底层的反向传播算法进行挑战,寻找反向传播的更优解尝试。

而在算法侧,RockAI更是在上半年起初有所冲突,在东谈主脑神经元分区激活的启发下,竣事了类脑分区激活的责任机制。

如同东谈主开车跟写字会离别激活脑部的视觉区域和阅读区域一般,Yan 1.2也不再需要全量的参数去考试,会阐明学习的类型和常识的范围来决定只拯救哪部分心经元,而这种分区的激活姿首不仅不错减少数据考试量,同期也能灵验发达多模态的后劲,该算法被RockAI称作基于仿生神经元驱动的弃取算法。

数据标明,东谈主脑的神经元大致是800-1000亿,功耗大致是20-30瓦,而一台GPU算力工作器功耗能到2000瓦,这就意味着主流大模子的全参数激活,本人等于无谓要的大功耗奢侈。

在本年3月类脑分区激活的责任机制竣事后,以至10亿级参数的Yan模子通过矫正在0压缩和0编著的情况下在一台7年前分娩的Mac条记本的CPU上跑通。

2个月后,“原生无损”跑通树莓派的故事便在RockAI按期而至。

剑指“同步学习”,Yan模子也能千东谈主千面

跑通树莓派,是RockAI走通低端斥地上的里程碑,同期也预示着距离其“同步学习”办法落地更近了一步。

家喻户晓,Transformer大模子带来一种开发范式——先通过预考试让大模子具备一定的基本才能,然后鄙人游任务中通过微调对皆,引发模子举一反三的才能。

但这样的云霄大模子虽好,在实行中却有着不成及时矫正和学习的问题。

Transformer架构在大参数大数据的情况下,想在预考试完成之后再大规模的反向更新代价极其大的,尤其对算力条件十分高,更别提返到原厂去重新考试的时期和经济资本。

也就导致在严谨内容场景下,一朝有内容和评价发生较大迁移,Transformer大模子学徒们络续要1-2个月去把数据清掉后,再重新考试后进行提交,客户一般很难经受。

这些toB实行中的信得过反馈,让刘凡平意志到客户对模子立即更新的需求,这条件模子不仅具备及时学习的才能,同期学习之后不成瞎掰八谈。

怀揣着“机器能否具有像东谈主同样及时学习的才能”的想考,以及随着客户信得过需求走的大场所领导,同步学习这一解法,在RockAI迟缓明晰。

比拟较泛机器学习领域的及时学习和在线学习、增量学习等办法,刘凡平以为RockAI首创的同步学习办法相反性在于,作念常识更新和学习时在模子层面考试和推理同步进行,以期及时、灵验且抓续性地援助大模子的智能智商,嘱咐各样个性化场景中出现的问题。

而要归拢快速更新的问题,波及到咫尺神经集会的底层旨趣,内容上神经集会的考试是前向传播和反向传播的流程。

就如同你正在玩一个猜数字游戏,你需要猜出一个1到100之间的当场数。在运行时,你没联系于这个数字的任何信息,是以你的第一次预计可能是基于直观或是随性选了一个数,比如50。这就好比是神经集会中的前向传播——在莫得任何历史数据的情况下,阐明现时的参数(权重和偏置)进行一次揣度。

当你预计了50后,游戏会告诉你这个数字“太大”或“太小”。淌若你听到“太大”,那么下一次预计时,你会弃取小于50的一个数;淌若得到反馈是“太小”,你则会弃取一个大于50的数。

这就访佛于反向传播对参数的编削流程。只消模子拯救饱胀快、代价饱胀小,就能更快达到预期,竣事从感知到理解再到决策这一轮回的加快,对现存常识体系进行快速更新。

为此,RockAI给出的同步学习解法落在,束缚尝试寻找反向传播的更优解,试图能更低代价更新神经集会,同期以模子分区激活镌汰功耗和竣事部分更新,从而使得大模子不错给到客户后抓续成长,像东谈主类学习同样树立我方私有的常识体系。

在刘凡平的设想中,通过同步学习,Yan模子部署到各样斥地后,会更像贴身伴侣,陪同着个东谈主的民俗去进行学习和工作,越来越具备个性化的价值,让手机、电脑,以至电视、音响等智能家居都能个性化适配到每个东谈主,最终酿成可交互的各样性智能生态。

如斯说来,那等于每个东谈主在斥地上都会找到我方的Jarvis(钢铁侠的AI管家)。

奔赴2.0,RockAI蓄力C端买卖化

把时期线拉长到近半年来看,RockAI的迭代呈现加快度。

3月,类脑分区激活的责任机制竣事;5月初,“无损”跑通树莓派;5月底,全模态部分视觉相沿走通。

固然同步学习仍在实验室终末考证阶段,仍需要大规模测试,但刘凡平示意,随着把多模态的视觉、触觉和听觉才能补皆,Yan 2.0也最快于本年年底面世。

“届时,全模态相沿+及时东谈主机交互+同步学习的落地,Yan 2.0的出现或将补皆具身智能的大脑短板。”

本领端的加快,背后是团队“受罪”换来的。刘凡平坦言,干的都是其他厂商“不肯干”,也可能“干不了”的活。

算法端,RockAI兵分两路,一部分去作念基础算法和模子架构的调动升级,在1.2基础上朝着2.0进发;另一部分则平日集会客户反馈,通过束缚拯救去逼近买卖化落地。

刘凡平以为唯有最猛进程赢得来自于外界和客户的感知和需求,才能幸免闭门觅句与用户的距离太远,渐渐酿成明确和明晰的买卖化阶梯。

而算法调动外,要竣事Yan 2.0落地即买卖化的将来,工程团队也在作念多量的圭臬化的“邻近”补皆,包括基础步地、系统、请托等方方面面,处治决策团队更是从起初买卖化的B端客户“扫”到斥地厂商,边进化边考证降本增效和市集招供度。

刘凡平也带着团队驰驱于上海、深圳、杭州等地,与中科晨曦、华为昇腾、壁仞科技、广电五舟等宽敞硬件和芯片厂商树立了换取,在端侧模子的适配责任上,刘凡平能感受到斥地端“积极提供测试机”的柔软,尽头是树莓派跑通明给到了话语权,机器东谈主厂商们都运行竞相窥探。

而这些前置责任,都为接下来Yan2.0落地相宜场景可能试产1-2万台的标品规模化作念足“赶紧跟上”的周期准备。

就端侧模子来说,刘凡平以为关于斥地厂商而言,是访佛Windows操作系统般的存在。现阶段可能是系统在适配各式硬件,到了斥地厂商真切了解模子的东谈主工智能才能后,就需要斥地反向兼容操作系统,而两者协力,是社会单干分娩力变化的一个例必趋势。

“站在toC智能化以至具身智能的空话题下,端侧模子需要集中推行载体(即硬件)去作念适配研究和迭代矫正,才能迟缓酿成圭臬化的类Windows操作系统,既不错装在个东谈主电脑也不错适配穿着斥地,而不同的体魄就会需要不同的脑子,咱们所构想的通用东谈主工智能,是在诸如智高手机、机器东谈主以偏激他各样化斥地上展现出的超过稳妥力与高度个性化的交互才能。”

行为一家从B端买卖化考证过“模”力的企业,刘凡平坦言,现时买卖化重点部署到C端斥地,是低算力的基因使然,亦是AI与腹地斥地集中的个性化趋例必然,亦然跳出B端买卖化内卷,霸占C端蓝海市集的先机。

在RockAI的办公室内,摆满了宽敞的各样硬件斥地,刘凡平笑谈,还有多量的适配和兼容责任需要完成,而一旁来自深圳各个厂商的机器东谈主也在恭候适配他们的“大脑”。

从Yan 1.0到Yan 1.2,RockAI花了4个月时期九游会J9,再到2.0,想必也不会太久。